De G7 landen staat op het punt een vrijwillige ‘gedragscode’ op te stellen voor bedrijven die vooruitstrevende kunstmatige intelligentie (AI)-systemen ontwikkelen. Dit initiatief, dat voortkomt uit het “Hiroshima AI-proces,” beoogt de mogelijke misbruiken en risico’s van deze revolutionaire technologie aan te pakken.

De G7, bestaande uit Canada, Frankrijk, Duitsland, Italië, Japan, het Verenigd Koninkrijk, de Verenigde Staten en de Europese Unie, hebben dit proces in gang gezet om een voorbeeld te stellen voor AI-governance.

De gedragscode voor AI

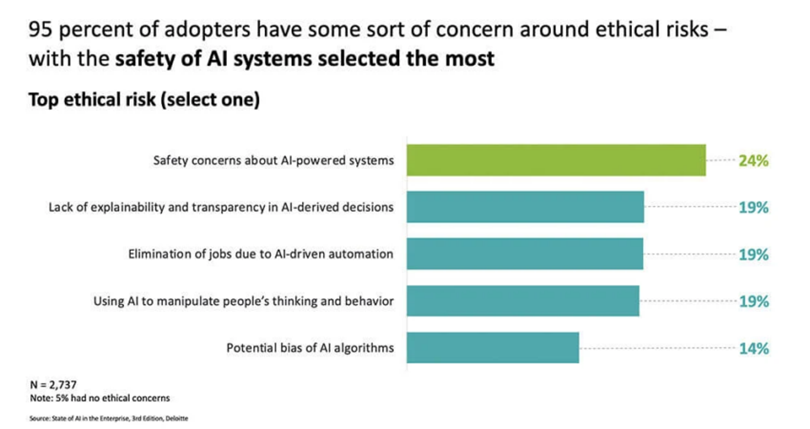

In het licht van groeiende bezorgdheid over privacy en veiligheidsrisico’s vormt de 11-punten gedragscode een lichtpunt van hoop. Volgens een document van de G7 heeft deze gedragscode als doel:

“Het wereldwijd bevorderen van veilige en betrouwbare AI en het verschaffen van vrijwillige richtlijnen voor acties van organisaties die de meest geavanceerde AI-systemen ontwikkelen.”

De code moedigt bedrijven aan om risico’s gedurende de gehele levenscyclus van AI te identificeren, te evalueren en te beperken. Bovendien beveelt de code aan om openbare rapporten te publiceren over de mogelijkheden, beperkingen en het gebruik van AI, met een sterke nadruk op robuuste beveiligingsmaatregelen.

Vera Jourova, het hoofd van digitale zaken van de Europese Commissie, verklaarde tijdens een forum over internetgovernance:

“Een gedragscode vormt een stevige basis om veiligheid te waarborgen en zal dienen als een brug naar regulering, in afwachting van verdere wetgeving.”

OpenAI’s Paraatheidsteam

OpenAI, het bedrijf achter ChatGPT, heeft tevens een Paraatheidsteam in het leven geroepen om de risico’s omtrent AI-modellen te adresseren. Dit team, onder leiding van Aleksander Madry, zal zich bezighouden met kwesties zoals gepersonaliseerde overtuigingen, bedreigingen op het gebied van cyberbeveiliging en de verspreiding van desinformatie.

Dit initiatief vormt OpenAI’s bijdrage aan de komende internationale AI-top in het Verenigd Koninkrijk en weerspiegelt de wereldwijde oproep tot veiligheid en transparantie in de ontwikkeling van AI-technologie.

De Britse overheid definieert ‘Frontier AI’ als volgt:

“Zeer geavanceerde AI-modellen voor algemene toepassingen die in staat zijn om een breed scala aan taken uit te voeren en de capaciteiten van de meest geavanceerde huidige modellen kunnen evenaren of overtreffen.”

Het Paraatheidsteam van OpenAI zal zich richten op het beheersen van deze risico’s, wat de noodzaak voor een wereldwijde gedragscode met betrekking tot AI nog urgenter maakt.

Naarmate de ontwikkeling van AI voortschrijdt, getuigen de proactieve inspanningen van de G7 en het engagement van OpenAI voor risicobeheersing van een tijdige reactie. Zowel de vrijwillige ‘gedragscode’ als de oprichting van een speciaal paraatheidsteam zijn cruciale stappen om de kracht van AI op een verantwoorde manier te benutten, met als doel de voordelen te maximaliseren terwijl potentiële risico’s doeltreffend worden beheerst.

Het bericht G7-landen dringen aan op AI-gedragscode om misbruik van technologie te voorkomen verscheen eerst op Newsbit.